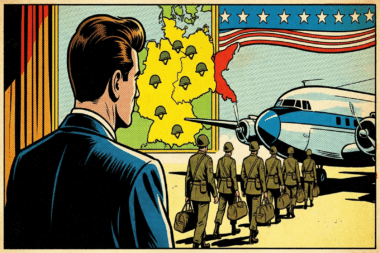

OpenAI conclut un accord avec le ministère de la Défense américain pour déployer ses technologies d’IA. Le partenariat soulève des inquiétudes autour de la surveillance et des armes autonomes.

Une alliance stratégique entre OpenAI et le ministère de la Défense

L’entreprise américaine OpenAI, connue pour ses modèles d’intelligence artificielle comme ChatGPT, a officialisé un partenariat avec le ministère de la Défense des États-Unis. Cette collaboration marque une nouvelle étape dans l’intégration de l’IA dans les stratégies militaires. L’objectif affiché consiste à développer des outils capables d’améliorer l’analyse de données, la cybersécurité ou encore certaines tâches administratives au sein des forces armées.

Ce rapprochement s’inscrit dans un programme plus large visant à tester l’utilisation de technologies d’IA avancées dans le domaine de la sécurité nationale. Dès 2025, le Pentagone avait attribué à plusieurs entreprises technologiques, dont OpenAI, des contrats pouvant atteindre 200 millions de dollars pour expérimenter ces systèmes dans différents scénarios opérationnels. Ces projets portent notamment sur l’analyse de données complexes, la détection précoce de cyberattaques et l’automatisation de processus internes.

La signature de ce nouvel accord intervient dans un contexte particulier. Quelques jours auparavant, le Pentagone avait mis fin à sa collaboration avec la société d’IA Anthropic, après un désaccord sur les conditions d’utilisation de ses modèles. Le gouvernement américain souhaitait un accès plus large à la technologie, ce que l’entreprise avait refusé pour des raisons éthiques. La rupture de cette coopération a laissé la place à OpenAI pour prendre le relais dans certains projets liés à l’intelligence artificielle militaire.

Cette évolution illustre la place croissante de l’IA dans les politiques de Défense. Pour les autorités américaines, ces outils pourraient accélérer l’analyse d’informations stratégiques et soutenir la prise de décision. Pour OpenAI, il s’agit également d’un moyen de renforcer sa présence dans le secteur public, à travers son initiative « OpenAI for Government », destinée à fournir des solutions d’IA aux institutions publiques.

Surveillance et armes autonomes : des lignes rouges affichées

La collaboration entre OpenAI et le ministère de la Défense ne s’est toutefois pas faite sans controverse. Plusieurs observateurs ont exprimé leurs inquiétudes concernant l’usage potentiel de ces technologies pour la surveillance de masse ou pour le développement d’armes autonomes. Face à ces critiques, la direction d’OpenAI a rapidement insisté sur l’existence de limites strictes dans le contrat conclu avec l’administration américaine.

Selon l’entreprise, l’accord prévoit plusieurs garde-fous. Les systèmes fournis par OpenAI ne pourront pas être utilisés pour surveiller massivement les citoyens américains ni pour déclencher automatiquement des actions létales. La responsabilité humaine doit rester au cœur de toute décision impliquant l’usage de la force. L’entreprise affirme également que ses outils ne pourront pas être employés pour cibler des attaques sans supervision humaine.

Le cadre technique du partenariat prévoit aussi un déploiement contrôlé. Les modèles d’OpenAI doivent fonctionner dans des environnements sécurisés, souvent via des infrastructures cloud spécifiques, et sous la supervision de personnels habilités. Des mécanismes contractuels permettraient théoriquement de suspendre l’accord en cas d’utilisation non conforme aux règles établies.

Malgré ces assurances, le débat reste intense. Des critiques soulignent que l’implication d’acteurs privés dans les technologies militaires pose des questions fondamentales sur la gouvernance de l’intelligence artificielle. Certains employés de grandes entreprises technologiques ont d’ailleurs appelé à limiter l’usage de l’IA dans les domaines liés à la surveillance ou à la guerre autonome.

Le partenariat entre OpenAI et le Pentagone illustre ainsi les tensions qui accompagnent l’essor rapide de l’intelligence artificielle. D’un côté, les gouvernements voient dans ces outils un levier stratégique majeur pour la Défense et la cybersécurité. De l’autre, chercheurs, employés du secteur technologique et utilisateurs s’inquiètent des dérives possibles.

Dans ce contexte, OpenAI tente de se positionner comme un acteur prêt à collaborer avec les institutions tout en maintenant certaines limites éthiques. Reste à savoir si ces garde-fous suffiront à rassurer l’opinion publique et à encadrer durablement l’utilisation de l’IA dans les opérations militaires.